Algorithme et radicalisation. De TikTok à X en passant par YouTube, les algorithmes façonnent désormais notre vision du monde. En personnalisant chaque contenu, ils créent des bulles idéologiques où opinions et émotions se renforcent en boucle. Derrière cette mécanique invisible, une question centrale émerge : les réseaux sociaux participent-ils à la radicalisation des individus et à la fragmentation du débat public ?

Une mécanique invisible au cœur de nos écrans

Le lien entre algorithme et radicalisation s’impose aujourd’hui comme un enjeu central du débat public. Derrière l’apparente neutralité des réseaux sociaux, une réalité plus complexe se dessine : chaque contenu affiché sur TikTok, X ou YouTube est le résultat d’une sélection automatisée, conçue pour capter l’attention et maximiser le temps passé à l’écran.

Ces algorithmes ne sont pas programmés pour informer, mais pour engager. Leur objectif est simple : proposer à chaque utilisateur les contenus les plus susceptibles de provoquer une réaction — qu’elle soit émotionnelle, cognitive ou impulsive. Or, ce sont précisément les contenus les plus polarisants, les plus clivants ou les plus choquants qui génèrent le plus d’interactions.

Dans ce contexte, la relation entre algorithme et radicalisation devient presque mécanique. Plus un contenu suscite de réactions, plus il est diffusé. Plus il est diffusé, plus il structure la perception de celui qui le consomme. C’est ce qui expliquer la violence politique que l’on connait aujourd’hui en France.

La bulle idéologique : un enfermement progressif

Le phénomène des bulles informationnelles n’est pas nouveau, mais il atteint aujourd’hui un niveau inédit. Sur les réseaux sociaux, chaque utilisateur évolue dans un environnement informationnel personnalisé, façonné par ses clics, ses likes, ses partages et même son temps d’arrêt sur une vidéo.

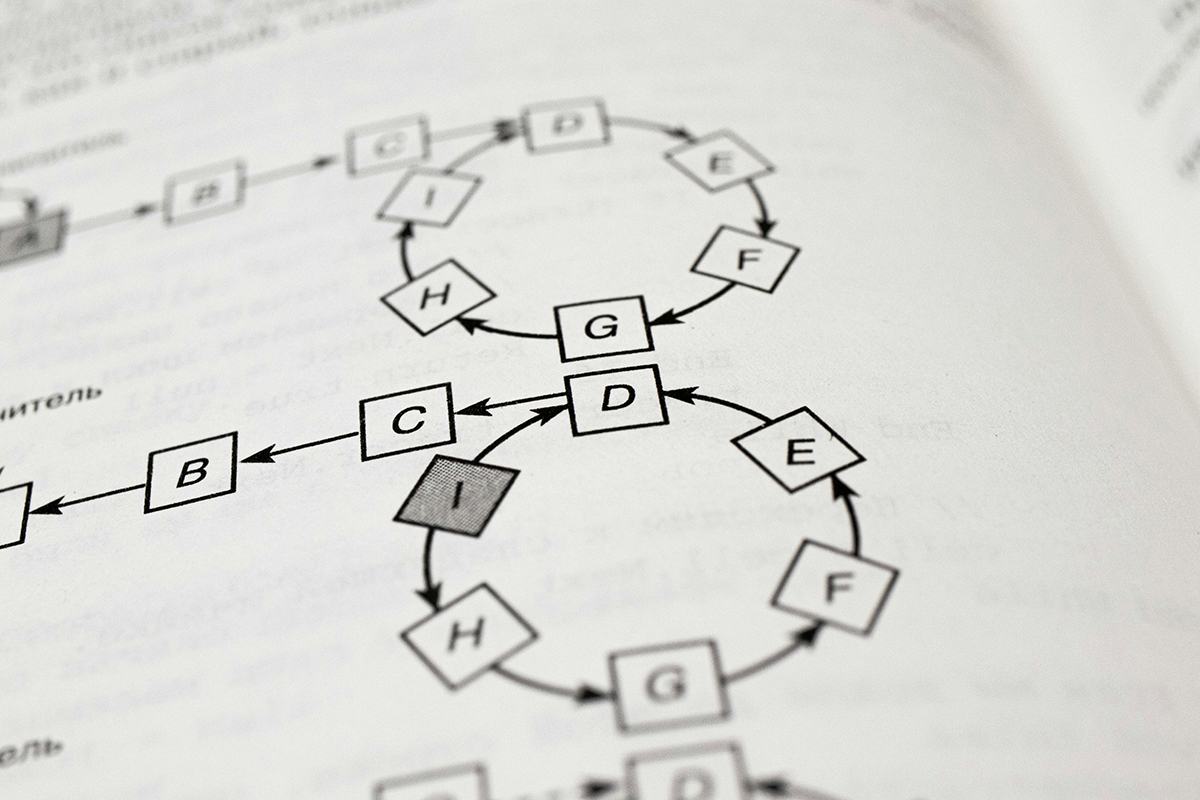

Cette logique crée ce que les chercheurs appellent des « bulles de filtres ». Progressivement, l’utilisateur est exposé à des contenus de plus en plus homogènes, qui confirment ses opinions initiales. Ce mécanisme de renforcement cognitif est au cœur du lien entre algorithme et radicalisation.

Sur TikTok, par exemple, quelques secondes d’attention sur une vidéo politique suffisent à orienter durablement le fil de recommandations. Sur YouTube, l’enchaînement automatique de vidéos peut conduire, en quelques clics, d’un contenu modéré à des positions beaucoup plus extrêmes. Sur X, l’effet de viralité amplifie les prises de position les plus tranchées.

Ce processus n’est pas nécessairement intentionnel, mais il est structurel. L’algorithme ne distingue pas le vrai du faux, ni le modéré de l’extrême. Il privilégie ce qui fonctionne.

De l’engagement à la radicalisation : une pente glissante

Le passage de l’exposition à la radicalisation ne se fait pas du jour au lendemain. Il s’inscrit dans une progression lente, souvent imperceptible pour l’utilisateur lui-même.

Au départ, il s’agit simplement de contenus engageants. Puis viennent des messages plus affirmés, plus militants, plus émotionnels. Enfin, certains discours peuvent devenir ouvertement radicaux, voire violents.

Cette dynamique est renforcée par un biais psychologique bien connu : le biais de confirmation. L’individu a tendance à rechercher et à valoriser les informations qui confortent ses convictions. L’algorithme, en amplifiant cette tendance, devient un accélérateur de radicalisation.

Dans cette logique, la combinaison entre algorithme et radicalisation produit un effet de spirale : plus l’utilisateur est exposé à un type de contenu, plus il y adhère, et plus ce type de contenu lui est proposé.

Le rôle central des émotions dans la viralité

Si les contenus extrêmes circulent autant, ce n’est pas un hasard. Ils activent des émotions fortes : colère, peur, indignation. Or, ces émotions sont les moteurs principaux du partage sur les réseaux sociaux.

Les algorithmes, en analysant les comportements, identifient rapidement les contenus qui déclenchent ces réactions. Ils favorisent alors leur diffusion, créant une forme de sélection naturelle de l’information.

Dans ce contexte, le lien entre algorithme et radicalisation est aussi un lien entre émotion et visibilité. Plus un contenu est émotionnellement chargé, plus il a de chances d’être vu, partagé et commenté.

Ce mécanisme explique en partie pourquoi les débats en ligne deviennent de plus en plus violents. La modération, la nuance et la complexité sont moins performantes que les prises de position tranchées.

TikTok, X, YouTube : trois modèles, une même logique

Chaque plateforme possède ses spécificités, mais toutes reposent sur des logiques similaires.

Sur TikTok, l’algorithme est particulièrement puissant. Il ne repose pas sur les abonnements, mais sur la capacité d’une vidéo à capter l’attention. Cela permet une diffusion extrêmement rapide de contenus, y compris politiques ou idéologiques.

Sur YouTube, le système de recommandations favorise l’enchaînement de vidéos. Ce modèle peut conduire à une intensification progressive des contenus, notamment sur des sujets sensibles.

Sur X, la logique est davantage conversationnelle. Les algorithmes mettent en avant les contenus qui suscitent le plus d’interactions, ce qui favorise les prises de position clivantes et les affrontements publics.

Dans les trois cas, la relation entre algorithme et radicalisation repose sur une constante : la recherche de l’engagement maximal.

Une responsabilité partagée : plateformes, médias, utilisateurs

Face à cette dynamique, la question de la responsabilité se pose. Les plateformes sont régulièrement accusées de favoriser la radicalisation en ligne. Elles mettent en avant leurs efforts de modération, mais reconnaissent implicitement les limites de leurs systèmes.

Les médias jouent également un rôle. En relayant certains contenus viraux, ils participent à leur amplification. La frontière entre information et viralité devient parfois floue.

Mais les utilisateurs eux-mêmes ne sont pas totalement passifs. Chaque interaction — like, partage, commentaire — alimente l’algorithme et contribue à orienter les contenus proposés.

Ainsi, le lien entre algorithme et radicalisation ne peut être réduit à une seule cause. Il résulte d’une interaction complexe entre technologie, économie de l’attention et comportements humains.

Peut-on sortir des bulles idéologiques ?

La question reste ouverte. Des solutions existent, mais elles nécessitent une prise de conscience collective.

Diversifier ses sources d’information, confronter ses opinions, ralentir sa consommation de contenus : autant de pratiques qui permettent de limiter l’effet des bulles algorithmiques.

Certaines plateformes expérimentent également des ajustements, comme l’introduction de contenus contradictoires ou la réduction de la visibilité de certains contenus sensibles. Mais ces mesures restent limitées face à la puissance des logiques économiques à l’œuvre.

Vers une fragmentation durable du débat public ?

Au-delà des individus, c’est le débat démocratique lui-même qui est impacté. Si chacun évolue dans une bulle idéologique distincte, le socle commun de compréhension du réel tend à disparaître.

Le risque est alors celui d’une société fragmentée, où le dialogue devient difficile, voire impossible. Dans ce contexte, le lien entre algorithme et radicalisation dépasse la sphère numérique pour devenir un enjeu politique majeur.

Les réseaux sociaux n’ont pas créé les divisions, mais ils les amplifient, les accélèrent et les rendent visibles en permanence.

Comprendre pour mieux résister

Loin des discours simplistes, la question de l’algorithme et de la radicalisation appelle une analyse nuancée. Les technologies ne sont ni bonnes ni mauvaises en soi, mais leurs effets dépendent des usages et des modèles économiques qui les sous-tendent.

Comprendre ces mécanismes constitue déjà une première étape. Car dans un environnement où l’information est filtrée, hiérarchisée et optimisée en permanence, la véritable liberté ne consiste plus seulement à accéder à l’information, mais à savoir la questionner.

Et peut-être, à retrouver la capacité de douter.